作者:谢佳佳 上海融力天闻律师事务所律师

2020年5月,被称为“人工智能生成内容第一案”的“威科案”[1]二审结果出炉,法院认为,“软件用户提交关键词并应用‘可视化’功能自动生成分析报告”的行为并非著作权意义上的“创作”。两年后,“Stable Diffusion案”[2]中,法院一改“威科案”的保守做法,认定运用“正向提示词”“反向提示词”并设置“参数”,通过人工智能作画软件“Stable Diffusion”“画出”人物肖像(见下图)是一种创作行为。

图源:“Stable Diffusion案”判决书

对比“威科案”与“Stable Diffusion案”,我们可以发现,在我国,著作权法“以人为本”的基本思想并未动摇,二案均明确提及“自然人创作”仍是作品认定的必要条件。正如国际保护知识产权协会(AIPPI)在《人工智能生成作品版权问题》强调的那样,“只有作品的创作过程中存在自然人的干预贡献,人工智能生成的内容才有资格构成作品”。然而,自然人之干预需要达到什么程度,该干预才能被认为是“创作”,进而享有《著作权法》为之圈定的一系列对世权利呢?

结合两案案情,法院似乎认为“输入‘电影’、设定判决法院与时间段”(“威科案”)是不够的,而“输入数十至数百个‘迷人的脸’‘细致的皮肤’等‘正向关键词’‘恶心’‘模糊’等‘反向关键词’,设置‘迭代步数’‘高度’等四种参数”(“Stable Diffusion案”)是充分的。诚然,从原告行为数量与维度来说,“Stable Diffusion案”毫无疑问是优于“威科案”的,但数量与维度之增加是否导致其行为的性质的变更,以至于越过了“思想与表达”那根神秘的分界线,使得原告行为在著作权法获得不同的评价呢?

本文将在界定“什么是‘创作’”的基础上对“‘Stable Diffusion’如何‘作画’”进行分析,以分享笔者对上述问题之浅见。

一、什么是《著作权法》语境下的创作?

何为“创作”?《著作权法实施条例》第三条有明文规定——“著作权法所称创作,是指直接产生文学、艺术和科学作品的智力活动”。而何为“作品”,《著作权法实施条例》第二条则规定:“著作权法所称作品,是指文学、艺术和科学领域内具有独创性并能以某种有形形式复制的智力成果”。

从以上规定我们可知创作行为需考察三个层面:一为“行为”——一种智力活动,二为“行为结果”——文学艺术科学领域能以某种形式复制的内容,最后一个要件则是“行为与行为结果关系”——前者直接产生后者。我们讨论使用AI画图工具过程中人类干预行为的定性问题时,并无需讨论“行为”与“行为结果”要件。原因在于,从“行为”角度出发,设置关键词、参数需要用户明确创作方向、发挥审美能力,判断生成内容是否符合要求,毫无疑问,属于一种智力活动,而从“行为后果”角度出发,AI画图工具成果也与常规的电子图画并无二致,均属于文学艺术科学领域能以某种形式复制的内容。因此本文讨论之核心便聚焦于“行为与行为结果关系”要件,即“设置关键词、参数的行为是否能够直接产生最终成果”。

关于何为“直接产生”,在同样探讨人工智能生成物可版性问题的“Dreamwriter案”[3]中法官认为“具体认定是否属于创作行为时应当考虑该行为是否属于一种智力活动以及该行为与作品的特定表现形式之间是否具有直接的联系”。而根据王迁老师的观点,这种特定表现形式被精准的界定为“表达性要素”(王迁老师认为:“‘直接产生’与‘间接影响’相对,是指人基于其自由意志直接决定了构成相关内容的表达性要素”[4])。再结合美术作品的定义:“美术作品,是指绘画、书法、雕塑等以线条、色彩或者其他方式构成的有审美意义的平面或者立体的造型艺术作品”[5],美术作品的表达性要素为其线条、色彩或其他审美要素,因此,进一步的,我们对于“用户设置关键词、参数是否属于创作”的判断即是对“用户该行为是否直接产生了线条、色彩或者其他审美要素”的判断(当然,用户行为成果若属于作品,是否属于美术作品是另一个需要讨论的问题,但因本文主要对是否构成作品的前序问题进行讨论,为使讨论问题具体以便于理解,本文直接以用户行为成果若构成作品即为美术作品为前提)。

二、“Stable Diffusion” 如何“作画”?

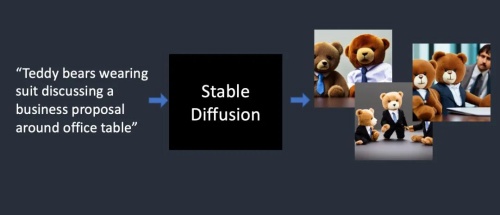

“Stable Diffusion案”中原告使用的软件“Stable Diffusion”是近两年大热的AI图像生成工具,“文生图”是其诸多功能中的一种,该功能可以凭借一段简单的描述便可生成高质量的相关图片,例如,输入“穿着西装的泰迪熊在办公桌边讨论商业提案”便可生成如下图像。

图源:大鱼科普文献[6]

“Stable Diffusion”与传统AI作画软件并不相同,传统软件使用的模型运作机理往往是“调用型”的,即通过对图像元素添加关键词,再让指令词与图像信息进行匹配,在指令词与预先设置的关键词一致的情况下,调用预先设置的图像并进行呈现,而“Stable Diffusion”则属于“生成型”工具,其预先通过数据训练“培养”一个掌握既定图像规律的模型,之后再根据用户输入内容,自主生成相应内容。

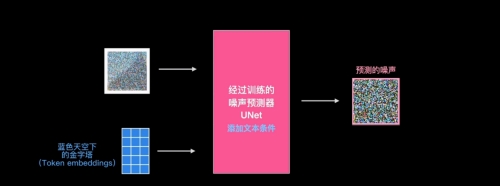

从构造角度来说,“Stable Diffusion”由“文本理解”与“图像生成”两个模块组成(见下图)。

图源:梗直哥科普视频[7]

“文本理解”模块负责采集用户的文本输入并将其转化为机器可以理解的数字语言。“图像生成”模块则结合“文本理解”模块递送的信息经由其内部的“图像信息创建器”创建出机器图像语言并最终通过“图像解码器”呈现出人类可识别的图像。

“机器学习”让AI获得“创作能力”

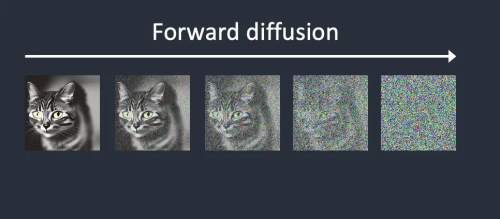

“图像信息创建器”是如何创建图像的呢?这涉及到该软件运行的核心机制——“扩散原理(diffusion)”,也即该软件名称的由来。“扩散”一词本意是指分子从高浓度向低浓度转移的物理现象,例如在水中加入一勺糖,糖分子逐渐溶解的过程,即为“扩散”,而对水进行加热,水分逐渐蒸发,最终又提取到糖的过程,则为“扩散”的逆过程。运用到图像生成的领域则是指:给定一张原始图片后,依次、定量的给图片增加噪声(可以理解为在图像上撒上一些细面粉,使得图像出现细节缺失),直至其变为不可辨认的完全噪声状态(见下图)。

图源:大鱼科普文献

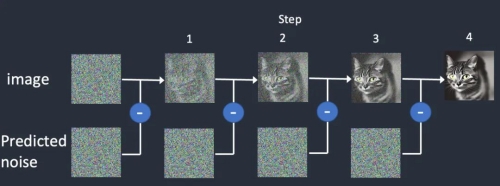

之后,再训练一个可以进行噪声预测的模块(Noise Predictor),预测出目前模糊态的图像具体添加的噪声(即预测出该图像被撒上了多少面粉及面粉具体的分布),将增加了噪声的图像逐步“减去”每一步预测的噪声(抹去预测的面粉),即可逐步将图像恢复到初始的状态,恢复的过程即为图像生成的过程(见下图),而使用的步骤次数则为“迭代步数”。

图源:大鱼科普文献

那“噪声预测模块”又是如何获得预测噪声的能力的呢?这得益于机器学习技术的发展。机器学习是一种通过增强算法对海量数据进行统计分析和数学建模,从而“学习”人类的思维模式进而形成先进算力的技术。具体到扩散模型中噪声预测模块的训练,其方法是,收集足够多的噪声图像作为输入,然后将真实噪声作为输出,在这过程中,对预测结果进行评价并对应调整参数,如此进行一段时间训练后便可获得具有一定精准度的“噪声预测模块”(见下图)。

图源:梗直哥科普视频

“调节机制”让用户设定影响“创作方向”

上文我们描述的图像生成过程是完全随机的,在不加入任何调节机制的情况下,生成内容可能是“美女”也可能是“野兽”,而“调节机制”的存在则可以使内容向我们想要的方向发展。在“文生图 (text-to-image)”功能的框架下,调节工具即是上文提及的“文本理解”模块。“Stable Diffusion”文本理解模块的核心模型是 OpenAI 在 2021 年初发布的用于匹配图像和文本的预训练神经网络——CLIP(Contrastive Language-Image Pre-Training)。CLIP训练使用的数据集包含了数量多达4亿的图像及其对应的文本描述,经过高强度的迭代训练之后,模型逐渐掌握了语言与图像之间的强对应关系。用户通过“文本理解模块”输入文本,经过CLIP模型进一步处理为“图像生成模块”可以理解语义信息,用以指导“噪声预测器”生成特定图片(见下图)。

图源:梗直哥科普视频

三、用户对提示词、参数的设定并不直接产生最终内容的表达性要素

从上文分析我们可以看出,“Stable Diffusion”与传统的画笔或photoshop等电子绘图工具并不相同,其能够将数据训练过程中习得的图像规律运用在特定的命题中,换言之,其自身具有“创作”能力。用户输入的“害羞”、“可爱”等提示词,只是作为一个调节因子,影响了AI作画软件的生成方向,最终成果中包含的表达性要素还是由AI作画软件决定。同时,可以想见,若将同一套用户操作(设置相同的关键词、参数等)输入不同的AI作画软件,生成的结果大概率是不同的。其原因在于,不同的AI作画软件其使用的模型并不相同,每个模型采用的训练数据的数量、质量、训练方法也并不相同,这导致了不同AI作画软件对图像规律的“理解”是不同的,因此其生成结果势必也是各有不同的。若我们将用户对生成工具的设定认定为创作,同一创作行为却可能产生不同的创作成果,这显然是让人无法接受的。

用户对AI作画软件的设定行为是否属于创作这一问题在美国同样引起了广泛的讨论。时至今日,美国版权局[8]对人工智能生成物是否属于作品进行过四次的判定,其中,2023年年初的“黎明的扎利亚《Zarya of the Dawn》案”(“黎明案”)与我国的“Stable Diffusion案”如出一辙。“黎明案”中争议作品为美国艺术家Kristina Kashtanova创作的科幻漫画书,该漫画书图像部分为该艺术家使用AI作画软件Midjourney自动生成(Midjourney与Stable Diffusion核心模型均是扩散模型)。与我国法官认为用户的设定行为属于创作不同,美国版权局认为文字指令只能干预AI的生成方向,而不能决定最终生成产物,因此拒绝将该部分内容登记为作品。而在该案之后,美国版权局进一步发布了《含人工智能生成内容的作品登记指南》(Copyright Registration Guidance: Works ContAIning Material Generated by Artificial Intelligence),在该指南中,美国版权局直接表示“若用户对系统如何阐释指令和生成内容并未运用最终的创造性控制力。......是机器决定了如何在输出结果中执行这些指令。由此产生的内容并不是人类创作的结果”。

设定复杂细致的提示词是创作吗

有观点认为:虽然使用部分抽象提示词通过AI作画软件作画确实可能没有直接对最终成果的表达性要素进行选择与安排,但在特定情况下,用户的提示词足够具体,具体到对图像生成方向的约束力足够强时,设定提示词的过程也是一种创作行为。笔者认为,这样的观点与客观情况并不相符。一方面,以文字描述画面,特别对于有一定复杂度的画面,本身是非常难做到的,这是由文字本身的想象空间与视觉元素的确定性之间的固有的矛盾决定的。另一方面,AI作画软件内容生成能力的存在,决定了无论如何具体丰富的描绘,作为输入进入生成模型后,模型都存在一个固定的运算过程,这一过程会将模型经过训练习得的图像规律的理解以最终表达的方式呈现出来。

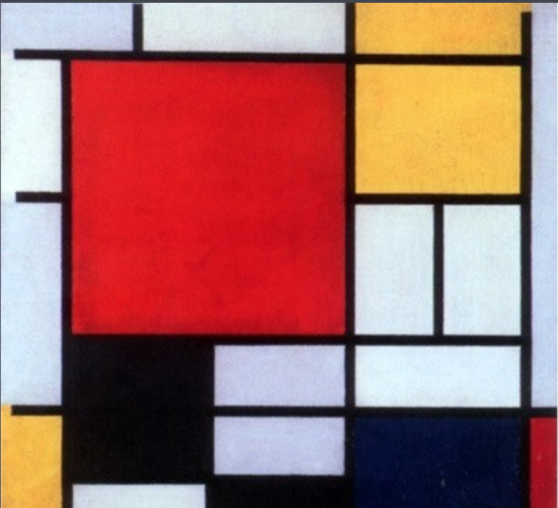

当然,也许有人会认为,特定情况下,文字是可以精准描绘画面的,例如,若目标画面是荷兰著名几何抽象派画家蒙德里安的一些作品,以简单的颜色与几何线条搭配为内容(如下图),向AI工具发出关于具体线条及颜色搭配的文字提示词,AI工具是很可能可以准确再现该作品的。

图源:百度百科

对此,笔者认为,在这样的情况下,AI工具本身实际上是不存在创作空间的,用户当然可以被认定最终创作了作品,但问题是,这样的AI工具更多是类似于语音识别那样的转换型AI,其追求的也更多是一比一的精准还原而不是内容创作,也就不是我们讨论的使用扩散模型等图像生成技术的AI。

相机与AI图像生成工具一样吗

有观点认为从传统画笔,到摄像师手中的相机,再到如今用于生成图片的AI,工具的法律性质从未改变,而AI生成内容的独创性来源于创作者使用工具时的干预手段及后期对AI生成内容的评价、筛选行为。对此,笔者认为通过对二者内容生成过程的观察,我们可以发现相机与AI存在显著的差异。首先,我们需要厘清的是,对于摄影作品而言其独创性来源并非是对客观世界的机械复制,而是对拍摄主体、光影、背景、布置、拍摄时机的选择,而这些独创性的选择直接决定了画面中的表达性要素,对此,早在1884年美国的“Burrow-Giles 案”[9]已有论述。而反观AI图像的生成过程,如前所述,在用户干预行为与最终成果之间始终横亘着生成模型的计算过程,用户的选择无论多么具有独创性,其对最终结果不具有控制力,并不能直接决定最终表达。而前述观点的一种衍生观点认为,摄影师时常对画面也缺乏控制力,比如,若以“抓拍”的方式进行拍摄,摄影师实际上也是面对着一个完全随机的过程,其无法准确预见成果,也无法对最终的成果施加控制力。对此,笔者曾就抓拍过程咨询过鸟类摄影爱好者,根据他的讲述,笔者发现其拍摄的过程确实充满了随机性。以下图的创作为例,摄影爱好者们会选取一个观鸟点,在风和日丽的一天,在特定位置架上摄影机,进行一些参数设定并设置好连拍模式,然后在投食点放上鸟食,之后便静待鸟群成群结队而来,最终,会在数十张照片中选取动态最好的作品。

猛一看,这过程似乎和AI生成过程设置关键词、参数之后静待成果的过程很相似,但实际上,二者并不相同。理由在于,创作者的选择对最终成果是否具有控制力,评估的是创作者的选择是否能够直接产生最终的内容,是否存在其他的随机力量打断这个生成过程,而不是评估创作者是否能够保证最终结果符合其开始的创作预期,也就是与摄影师想拍某种内容是否拍到,与一个画师想画一副肖像画是否画的像,没有关系。说回到“抓拍”这一形式,虽然这是一种包含许多随机性的创作方式,但先不考虑摄影师的各种设定本身会否符合创造性的要求(这需要个案分析)的情况下,当照相机“咔嚓”那一下之后,画面便固定了,随机性消失,随机性仅存在在拍摄之前。而反观AI创作,提示词、参数等被设定之后,随机性才发生,用户设定对最终成果的控制力被AI“创作”带来的随机性打断,因此,用户对最终成果是缺乏控制的。那么,如何评价用户对最终画面的选择呢?这个选择同样发生在随机性消失之后,是否可以被认为是一种创作呢?对此,笔者认为,在这个阶段的选择实际上只是一种判断,内容生成的过程已经完成,这个选择本身并不会产生任何成果,并不属于一种创作行为,而若用户基于这个判断继续新一轮的关键词、参数的设定则是另一轮随机性事件的启动,便如之前的论述一样,因缺乏对最终成果的控制力,难以被认为是一种创作行为。

注释:

[1](2019)京73民终2030号。

[2](2023)京0491民初11279号。

[3](2019)粤0305民初14010号。该案软件开发与使用为同一主体,与“威科案”“Stable Diffusion案”软件开发者与使用者分离的情况有所不同。

[4] 王迁:《再论人工智能生成的内容在著作权法中的定性》,《政法论坛》2023年第4期。

[5]《著作权法实施条例》第四条。

[6] 大鱼:《揭秘稳定扩散的神奇魔力 - 让您轻松理解StableDiffusion原理》,https://mp.weixin.qq.com/s/Jxkfh6TeN1CTSQNwwRnahQ;访问时间:2024年1月2日。

[7] 梗直哥:《【AI绘画 Diffusion 扩散模型】动画版破解,侧重思路适合小白》https://www.bilibili.com/video/BV1Wv4y1H77v/?buvid=ZE453DE21178D5AA41BC9D0FD256BE4EF05D&from_spmid=mAIn.later-watch.0.0&is_story_h5=false&mid=bp7xoMcu%2FqIRcxWipSdw%2Fw%3D%3D&p=1&plat_id=312&share_from=ugc&share_medium=iphone&share_plat=ios&share_session_id=789BC1F0-FEA1-4DCC-AF0C-28346B707B1C&share_source=WEIXIN&share_tag=s_i&spmid=playlist.playlist-video-detAIl.0.0×tamp=1704187736&unique_k=ReOKqyF&up_id=1921388479;访问时间:2024年1月2日。

[8] 根据《美国版权法》第411a条,起源国为美国的作品,只有在获得著作权登记后才可进行侵权诉讼,所以,与中国版权局发放的著作权登记证书并无实际确权效力不同,美国版权局会对作品自身是否具有可版权性进行实质审查。

[9] Burrow-Giles Lithographic Co. v. Sarony, 111 U.S. 53 (1884).

(本文仅代表作者个人观点,不代表知产财经立场)

查看更多知识产权精彩内容,请浏览知产财经官网:www.ipeconomy.cn

京公网安备 11010502049464号

京公网安备 11010502049464号